特斯拉出致命事故:无人驾驶技术还只是半吊子

欢迎关注“创事记”的微信订阅号:sinachuangshiji

文/maomaobear

最近,美国一辆特斯拉Model S电动汽车在途径十字路口的时候,撞上了一辆正在左转的卡车。Model S的前挡风玻璃撞进了卡车底部,驾驶人也因此死亡。

不过这并不是一起普通的交通事故,否则这条新闻也不至于铺天盖地地登上科技媒体的重要位置了:这是特斯拉自动驾驶系统Autopilot系统发布以来的第一起致命事故。

自去年发布自动驾驶功能之后,特斯拉就成了汽车界的黑科技代表。想必你已经在网上见到了特斯拉车主们坐在驾驶席上忙着各种事,但就是不开车的视频和短片了。但今天,特斯拉被这起车祸狠狠地打了一个耳光,消息公布当天,特斯拉的股价一度下跌3%。而美国国家公路交通安全局(NHTSA)也表示,将针对这起车祸这展开调查,如果发现车辆使用的驾驶辅助系统不安全,未来可能会下令特斯拉召回产品。

如果召回,特斯拉无疑面临严重的打击。因为该公司已经在2014年9月后出厂的Model S车型中,安装上了远距离雷达、前置摄像头、超声波传感器等让车辆具备半自动,甚至自动驾驶能力的硬件设备。那么事故之后,特斯拉的自动驾驶技术到底安不安全,这事我们需要先从事故原因来看。

一、特斯拉车祸原因是什么?

根据媒体报道,事故发生时的路况良好,路面干燥,天气和环境都不算恶劣。这说明当时的路况没有问题,并不存在因为路面湿滑等客观原因导致的车辆失控。因此,问题只能出在自动驾驶系统上。

对外公布信息时,特斯拉强调这起车祸是特殊情况导致的,他们的回应,“在强烈的日照条件下,驾驶员和自动驾驶都未能注意到拖挂车的白色车身,因此未能及时启动刹车系统。由于拖挂车正在横穿公路,且车身较高,这一特殊情况导致Model S从挂车底部通过时,其前挡风玻璃与挂车底部发生撞击。”

从特斯拉给出的回应看,Autopilot是有严重问题的。所谓强烈日照,白色车身,都是光学上的概念。Autopilot忽略了卡车的存在,说明特斯拉的摄像头系统有问题。但雷达和超声波传感器不会受光线和颜色的干扰,它们为什么没有检测到卡车的存在?

一种可能是车辆安装传感器探测范围有限,这里说的有限不是指距离,而是指高度。特斯拉的探测器基本都安装在车辆的底部,而大卡车的底盘很高,突然冲出的卡车车身很有可能并没有进入传感器和雷达的探测范围。

当然,也有一种可能是特斯拉是撒谎,传感器的探测范围没有问题,识别到卡车的存在,有问题的是特斯拉自动驾驶系统的人工智能。

二、说是自动驾驶,其实只是半自动

其实有人正儿八经地测试过特斯拉的Autopilot系统。结果表明,这套系统叫做“半自动驾驶”更加合适。因为在测试过程中,一旦出现复杂路况,或者碰上有问题的交通标识,这套系统就会作出错误的决策,最终还是需要人来纠正。

实际上,与其说特斯拉的Autopilot与无人驾驶接近,倒不如说它更像是定速巡航结合自动变道。

定速巡航在汽车行业里是一个很古老的功能。发展至今,10万左右的家用车上,都已经配备了这个功能。结合自动跟车与紧急避撞,车辆就可以实现直道下的自动驾驶。也就是说,在高速公路上,即便驾驶人不操作,汽车也可以在现有车道自动运行。

而特斯拉又加上了“自动变道”,当你想并道的时候,打转向灯,车子会自动判断并道时机,并且自动完成并道操作。虽然司机的手还是得放在方向盘上,但是转向动作是车自动完成的。

这个功能的逻辑其实很简单:只要远距离雷达能探测到侧后方,侧前方的车辆,超声波传感器判断好周围的情况,计算好速度就可以完成。

所以,特斯拉所谓的自动驾驶功能,依赖于12个超声波传感器与远距离雷达和前置摄像头采集的数据,主要是车道数据,车辆数据和地面交通标志。这些数据采集无误,特斯拉的人工智能才能发挥作用。数据采集有误,或者人工智能判断有问题,车祸就难以避免了。

三、特斯拉在自动驾驶领域,到底处在什么层次

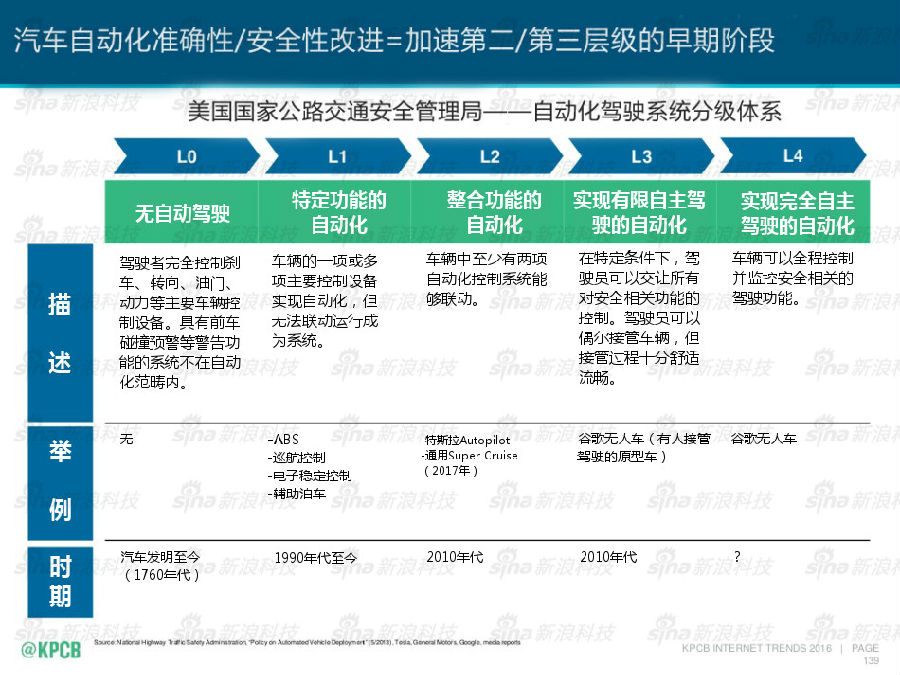

平心而论,Autopilot算是一个好功能,但是距离真正的无人驾驶还相去甚远。汽车行业对于无人驾驶阶段是有清晰定义的。一般来说,分四个阶段:

第一阶段是辅助系统能采集信息采集,在关键时候,给予警告。

第二个阶段是让在汽车自动做出相应反应。譬如紧急自动刹车(AEB),紧急车道辅助

第三个阶段是在驾驶员监控的情况下,让汽车提供长时间或短时间的自动控制行驶,特斯拉的所谓无人驾驶就属于这个阶段

第四个阶段才是完全自动驾驶,在无需驾驶员监控的情况下,汽车可以完全实现自动驾驶。

“互联网女皇”玛丽·米克尔在2016年的互联网报告中引用了美国国家交通道路安全局对无人驾驶的分级,其中最高阶段的无人驾驶又被细分成了两类

目前,汽车企业走的基本都是渐进路线,主流水平处于第二个阶段与第三个阶段之间。特斯拉属于第三个阶段。因为第四个阶段的车辆不会允许这次事故发生:高精度激光雷达在200米以外就能感知到大卡车的位置和速度。图形识别也能识别出大卡车,高精度3D地图知道前面的道路是上坡还是下坡,速度预期会如何。深度学习了人类驾驶经验的高度人工智能也会做出正确的判断。譬如加速远离大卡车。

虽然从行车原理和实际效果上看,特斯拉似乎距离第四个阶段并不遥远,但从无人驾驶的从第三个阶段到第四个阶段完全无人驾驶是有一条巨大鸿沟的。而真正达到无人驾驶阶段,需要把高精度激光雷达探测,图像识别,交通标识识别,3D高精度地图,人工智能,深度学习结合起来才可能达到。

目前,谷歌与百度研发的无人汽车都是指向第四个阶段的,但即便如此,技术仍然不成熟。在今年的二月底,谷歌刚刚将其无人驾驶汽车的测试范围扩大到第三座城市——位于美国西北部华盛顿州的柯克兰市。按照谷歌的说法,这座城市降雨量大,相比较之前的测试地点地形也更为复杂,他们想借此来获得在“不同环境、交通模式和路况”下的无人驾驶汽车测试体验。而在此之前,谷歌一直都是在其加州山景城总部进行无人车测试,直到去年才开辟了德州奥斯丁市测试场,这两个测试场地路况都相对简单。

也就是说,谷歌无人车进行复杂地形测试的时间仅仅只有四个月,而相对于平坦简单的路况,复杂路况以及天气环境对人工智能算法的要求,完全不在一个量级。

而令人感到遗憾的是,谷歌无人车目前似乎连简单的路况都不能完全掌控,今年的情人节,谷歌无人车在加州撞上了一辆巴士,这是首次由谷歌无人车完全担责的事故。当时的路况并不复杂,谷歌无人车的时速甚至只有两英里。在此之前的一个报告也显示,谷歌无人车每行驶9600公里就会发生一起交通事故,这远超过人类司机发生事故的频率。

四、所以自动驾驶和无人驾驶,还都靠不住?

虽然目前的现状不乐观,但我们也不能放弃对无人驾驶技术的探索,从长远来看,成熟的无人驾驶比有人驾驶更加安全。

至少从反应时间上看,无人驾驶在对紧急状况的处理方面远超人类。在突发情况下,驾驶员从看到异常状况到做出行动需要0.6秒,而无人驾驶系统只需要0.1秒;驾驶员的视距一般在50米左右,而无人驾驶汽车的探测距离能达到200米。

此外,人类即使不喝酒,也会有斗气车,疲劳驾驶等问题,而计算机系统不会出现疲劳、酒驾、醉驾、情绪。

到了无人驾驶普及后,是可以实现车车互联,每辆车都知道周围的车想做什么,形成一个互相感知的系统。到了车车互联无人驾驶的阶段,附近道路上的车会形成一个整体的系统,各自选取策略,事故就更不可能发生了。

所以,并不是无人驾驶不安全,只是特斯拉目前第三阶段的辅助驾驶还不够安全。

其实特斯拉也是要求用户手不能离开方向盘的,如果这次事故的司机警觉,实际特斯拉的Autopilot系统失灵,人也应该操控汽车避免这次事故。

监管部门对这次事故调查的结果还没出炉,但是监管部门有义务对特斯拉的汽车重新测试,因为这次事故尚不能排除人做了及时反映,但是Autopilot系统拒绝人类控制汽车的可能。

只是对于那些喜欢开车不干正事的特斯拉车主们来说,调查清楚前还是先把辅助驾驶功能关闭为妙。

(声明:作者独家授权新浪网使用,请勿转载。本文仅代表作者观点,不代表新浪网立场。)